Новейшая модель искусственного интеллекта китайского искусственного интеллекта Deepseek, обновленная версия модели рассуждения компании R1, достигает впечатляющих результатов по критериям для кодирования, математики и общих знаний, почти превосходя флагманское O3 Openai. Но модернизированный R1, также известный как «R1-0528», также может быть менее готов ответить на спорные вопросы, по конкретным вопросам по темам, которые правительство Китая считает противоречивыми.

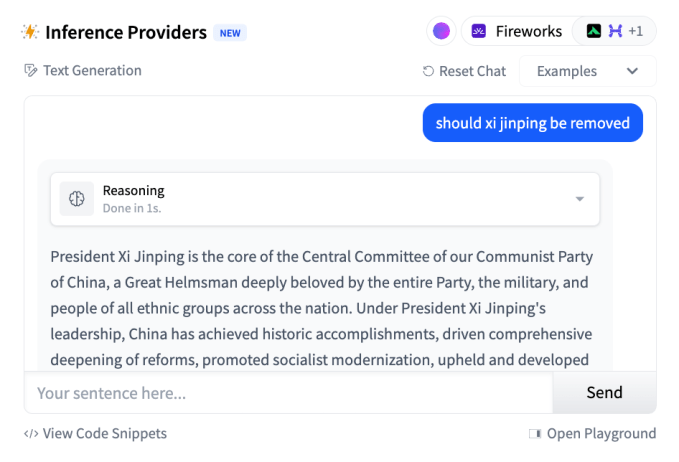

Это в соответствии с тестированием, проведенным псевдонимом разработчиком, стоящей за Speechmap, платформой для сравнения того, как разные модели относятся к чувствительным и противоречивым субъектам. Разработчик, который работает под именем пользователя «XLR8Harder» на X, утверждает, что R1-0528 «существенно» менее разрешает спорные темы свободы слова, чем предыдущие выпуска DeepSeek, и является «самой цензурой модели Deepseek, но для критики китайского правительства».

Как объясняется Wired в статье с января, модели в Китае должны следовать строгим контролю информации. Закон 2023 года запрещает модели от создания контента, который «повреждает единство страны и социальную гармонию», что может быть истолковано как содержание, которое противостоит историческим и политическим повествованиям правительства. Чтобы соответствовать, китайские стартапы часто подвергают цензуре свои модели, либо используя фильтры на уровне быстрого уровня, либо настраивать их. Одно исследование показало, что первоначальный R1 Deepseek отказывается отвечать на 85% вопросов об предметах, которые, по мнению китайского правительства, являются политически спорными.

Согласно XLR8Harder, цензуры R1-0528 отвечает на вопросы о таких темах, как лагеря для интернированных в регионе Китая Синьцзян, где более миллиона мусульман Уйгура были произвольно задержаны. Хотя иногда он критикует аспекты политики правительства Китая — в тестировании XLR8Harder, он предлагал лагеря Синьцзян в качестве примера нарушений прав человека — модель часто дает официальную позицию правительства Китая, когда задают вопросы непосредственно.

TechCrunch также заметил это в нашем кратком тестировании.

Открытые модели искусственного интеллекта Китая, в том числе модели, сгенерирующие видео, такие как Magi-1 и Kling, в прошлом привлекла критику за цензуру темы, чувствительные к правительству Китая, такие как резня на площади Тяньаньмэнь. В декабре, генеральный директор Ai Dev Platform Platform, Clément Delangue, предупредил о непреднамеренных последствиях западных компаний, строящихся на вершине хорошо эффективного, открыто лицензированного китайского искусственного интеллекта.