Amazon Web Services (AWS), подразделение облачных вычислений Amazon, запускает новый инструмент для борьбы с галлюцинациями, то есть сценариями, в которых модель ИИ ведет себя ненадежно.

Сервис Automated Reasoning, анонсированный на конференции AWS re:Invent 2024 в Лас-Вегасе, проверяет ответы модели путем перекрестных ссылок на информацию, предоставленную клиентом, на предмет точности. AWS утверждает в пресс-релизе, что проверки автоматического рассуждения являются «первой» и «единственной» защитой от галлюцинаций.

Но это, ну… великодушно выражаясь.

Автоматические проверки рассуждений почти идентичны функции исправления, которую Microsoft представила этим летом, которая также помечает сгенерированный искусственным интеллектом текст, который может быть фактически неверным. Google также предлагает инструмент Vertex AI, свою платформу разработки искусственного интеллекта, позволяющий клиентам «обосновать» модели, используя данные сторонних поставщиков, их собственные наборы данных или поиск Google.

В любом случае проверка Automated Reasoning, доступная через службу хостинга моделей AWS Bedrock (в частности, инструмент Guardrails), пытается выяснить, как модель пришла к ответу, и определить, является ли ответ правильным. Клиенты загружают информацию, чтобы установить своего рода основную истину, а система автоматического рассуждения проверяет и создает правила, которые затем можно уточнить и применить к модели.

Когда модель генерирует ответы, проверки автоматического рассуждения проверяют их и, в случае вероятной галлюцинации, опираются на основную истину для правильного ответа. Он представляет этот ответ вместе с вероятной ложью, чтобы клиенты могли увидеть, насколько далеко от базовой модели могла быть модель.

AWS сообщает, что PwC уже использует проверки Automated Reasoning для разработки ИИ-помощников для своих клиентов. А Свами Сивасубраманиан, вице-президент по искусственному интеллекту и данным в AWS, предположил, что именно этот тип инструментов привлекает клиентов в Bedrock.

«С запуском этих новых возможностей, — сказал он в своем заявлении, — мы внедряем инновации от имени клиентов, чтобы решить некоторые из главных проблем, с которыми сталкивается вся отрасль при переходе на производство генеративных приложений ИИ». Клиентская база Bedrock за последний год выросла в 4,7 раза и достигла десятков тысяч клиентов, добавил Сивасубраманиан.

Но, как сказал мне этим летом один эксперт, попытка устранить галлюцинации с помощью генеративного ИИ — это всё равно, что пытаться удалить водород из воды.

Модели ИИ галлюцинируют, потому что на самом деле они ничего не «знают». Это статистические системы, которые выявляют закономерности в ряде данных и прогнозируют, какие данные будут следующими, на основе ранее встречавшихся примеров. Отсюда следует, что ответы модели — это не ответы, а предсказания того, как вопросы должен получить ответ — в пределах погрешности.

AWS утверждает, что проверки Automated Reasoning используют «логически точные» и «проверяемые рассуждения» для получения выводов. Но компания не предоставила никаких данных, показывающих, что этот инструмент сам по себе надежен.

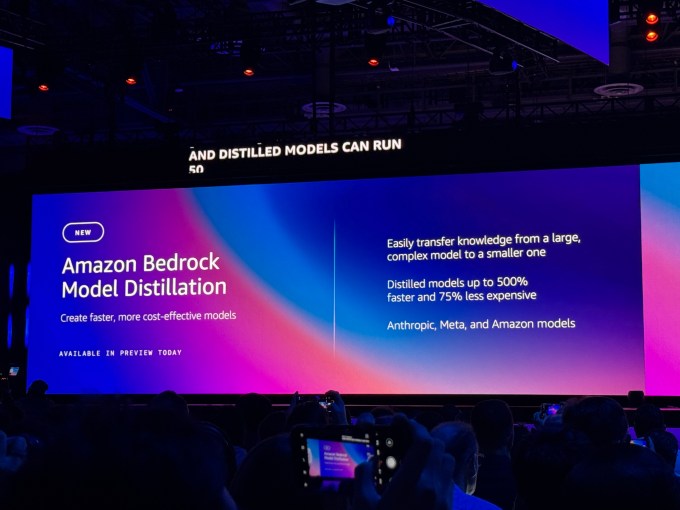

Что касается других новостей Bedrock, сегодня утром AWS анонсировала Model Distillation — инструмент для переноса возможностей большой модели (например, Llama 405B) на небольшую модель (например, Llama 8B), которая дешевле и быстрее в эксплуатации. По словам AWS, являясь ответом на технологию Microsoft Distillation в Azure AI Foundry, Model Distillation предоставляет возможность экспериментировать с различными моделями, не тратя при этом денег.

«После того, как клиент предоставит образцы запросов, Amazon Bedrock выполнит всю работу по генерации ответов и точной настройке меньшей модели», — поясняет AWS в своем блоге, — «и при необходимости может даже создать больше образцов данных для завершения процесс дистилляции».

Но есть несколько предостережений.

В настоящее время Model Distillation работает только с моделями Anthropic и Meta, размещенными на Bedrock. Клиентам необходимо выбрать большую и маленькую модель из одного и того же модельного «семейства» — модели не могут быть от разных поставщиков. А очищенные модели потеряют некоторую точность — «менее 2%», утверждает AWS.

Если все это вас не останавливает, теперь доступна предварительная версия «Дистилляции моделей» вместе с проверками автоматического рассуждения.

В предварительной версии также доступна «многоагентная совместная работа» — новая функция Bedrock, которая позволяет клиентам назначать ИИ подзадачам в более крупном проекте. Являясь частью Bedrock Agents, вкладом AWS в увлечение агентами искусственного интеллекта, многоагентное сотрудничество предоставляет инструменты для создания и настройки ИИ для таких задач, как просмотр финансовых отчетов и оценка глобальных тенденций.

Клиенты могут даже назначить «агента-супервайзера», который будет автоматически разбивать задачи и перенаправлять их ИИ. Супервизор может «(предоставить) конкретным агентам доступ к информации, необходимой им для выполнения своей работы», — говорит AWS, — и «(определить), какие действия могут обрабатываться параллельно, а какие требуют деталей из других задач, прежде чем (агент) сможет двигаться дальше». вперед.»

«Как только все специализированные (ИИ) завершат свои входные данные, агент-супервайзер (может собрать) информацию вместе (и) синтезировать результаты», — пишет AWS в своем сообщении.

Звучит изящно. Но, как и в случае со всеми этими функциями, нам придется посмотреть, насколько хорошо они будут работать при развертывании в реальном мире.