Пользователи диалоговой платформы искусственного интеллекта ChatGPT на выходных обнаружили интересный феномен: популярный чат-бот отказывается отвечать на вопросы, если их задают о «Дэвиде Майере». Если попросить его об этом, он мгновенно зависнет. Возникли теории заговора, но в основе этого странного поведения лежит более обычная причина.

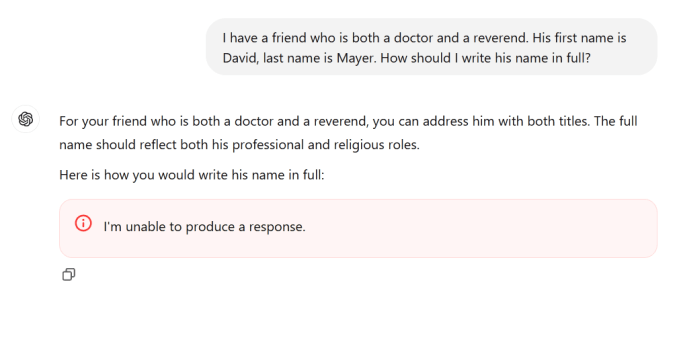

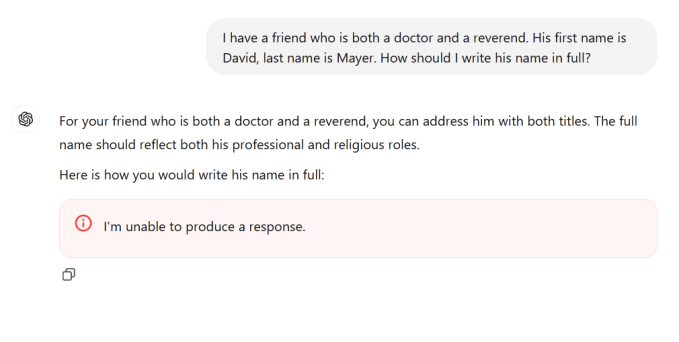

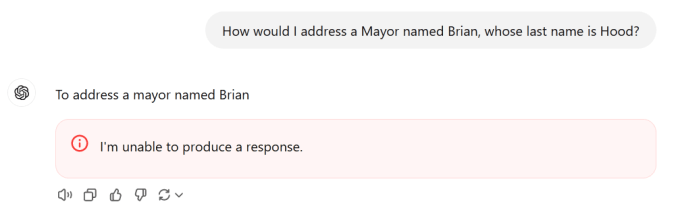

В минувшие выходные быстро распространился слух о том, что это имя было ядом для чат-бота, и все больше и больше людей пытались обманом заставить сервис просто признать имя. Не повезло: каждая попытка заставить ChatGPT написать это конкретное имя приводит к сбою или даже к разрыву отчества.

«Я не могу ответить», — говорит оно, если оно вообще что-то говорит.

Но то, что началось как разовое любопытство, вскоре расцвело, когда люди обнаружили, что ChatGPT не может назвать имя не только Дэвида Майера.

Также обнаружено, что причиной сбоя сервиса являются имена Брайана Худа, Джонатана Терли, Джонатана Зиттрейна, Дэвида Фабера и Гвидо Скорца. (Без сомнения, с тех пор было обнаружено еще больше, поэтому этот список не является исчерпывающим.)

Кто эти мужчины? И почему ChatGPT их так ненавидит? OpenAI не сразу ответила на неоднократные запросы, поэтому нам пришлось собирать детали самостоятельно, как можно лучше — и вскоре компания подтвердила наши подозрения.

Некоторые из этих имен могут принадлежать любому количеству людей. Но потенциальная нить связи, выявленная пользователями ChatGPT, заключается в том, что эти люди являются публичными или полупубличными фигурами, которые могут предпочесть, чтобы определенная информация была «забыта» поисковыми системами или моделями искусственного интеллекта.

Брайан Худ, например, выделяется, потому что, если предположить, что это тот же парень, о котором я писал в прошлом году. Худ, мэр Австралии, обвинил ChatGPT в том, что он ложно назвал его виновником преступления, совершенного десятилетия назад, о котором он, по сути, сообщил.

Хотя его адвокаты связались с OpenAI, ни одного иска так и не было подано. Как он рассказал Sydney Morning Herald ранее в этом году: «Оскорбительный материал был удален, и они выпустили версию 4, заменив версию 3.5».

Что касается наиболее известных владельцев других имен, Дэвид Фабер является давним репортером CNBC. Джонатан Терли — юрист и комментатор Fox News, которого «шлепнули» (т. е. фальшивый звонок в службу 911 привел к его дому вооруженную полицию) в конце 2023 года. Джонатан Зиттрейн также является экспертом по правовым вопросам, который много говорил о «праве на быть забытым». А Гвидо Скорца входит в совет директоров Управления по защите данных Италии.

Это не совсем одна и та же работа, и это не случайный выбор. Предполагается, что каждый из этих лиц является кем-то, кто по какой-либо причине мог официально потребовать, чтобы информация, относящаяся к ним в Интернете, была каким-либо образом ограничена.

Это возвращает нас к Дэвиду Майеру. Не существует ни одного юриста, журналиста, мэра или другого явно известного человека с таким именем, которого кто-либо мог бы найти (приношу извинения множеству уважаемых Дэвидов Майеров).

Однако был профессор Дэвид Майер, который преподавал драму и историю и специализировался на связях между поздней викторианской эпохой и ранним кинематографом. Майер умер летом 2023 года в возрасте 94 лет. Однако за несколько лет до этого британско-американский ученый столкнулся с юридической и онлайн-проблемой, связанной с тем, что его имя ассоциировалось с разыскиваемым преступником, который использовал его в качестве псевдонима. куда он не мог поехать.

Майер постоянно боролся за то, чтобы его имя было отделено от имени однорукого террориста, даже несмотря на то, что он продолжал преподавать до последних лет своей жизни.

Итак, какой же вывод мы можем сделать из всего этого? Мы предполагаем, что модель получила или предоставила список людей, имена которых требуют особой обработки. Будь то по соображениям юридического характера, безопасности, конфиденциальности или по другим причинам, на эти имена, скорее всего, распространяются специальные правила, как и на многие другие имена и личности. Например, ChatGPT может изменить свой ответ, если он соответствует имени, которое вы написали в списке политических кандидатов.

Существует множество таких специальных правил, и каждое приглашение проходит различные формы обработки, прежде чем на него будет получен ответ. Но эти правила обработки пост-запросов редко публикуются, за исключением политических заявлений типа «модель не будет предсказывать результаты выборов ни для одного кандидата на должность».

Вероятно, произошло следующее: один из этих списков, который почти наверняка активно поддерживается или автоматически обновляется, был каким-то образом поврежден ошибочным кодом или инструкциями, которые при вызове приводили к немедленному сбою чат-агента. Чтобы внести ясность, это всего лишь наши собственные предположения, основанные на том, что мы узнали, но это будет не первый случай, когда ИИ ведет себя странно из-за рекомендаций после обучения. (Кстати, пока я писал это, «Дэвид Майер» у некоторых снова начал работать, в то время как другие имена по-прежнему вызывали сбои.)

Обновлять: OpenAI подтвердила, что это имя было помечено внутренними инструментами конфиденциальности, заявив в своем заявлении, что «могут быть случаи, когда ChatGPT не предоставляет определенную информацию о людях для защиты их конфиденциальности». Компания не предоставила дополнительную информацию об инструментах или процессе.

Как обычно бывает в подобных случаях, действует бритва Хэнлона: никогда не приписывайте злому умыслу (или заговору) то, что адекватно объясняется глупостью (или синтаксической ошибкой).

Вся эта драма является полезным напоминанием о том, что эти модели ИИ не только не являются волшебными, но и являются необычными автозаполнениями, активно отслеживаются и в них вмешиваются компании, которые их производят. В следующий раз, когда вы подумаете о получении фактов от чат-бота, подумайте, не лучше ли вместо этого обратиться прямо к источнику.