Привет, ребята, добро пожаловать в регулярный информационный бюллетень TechCrunch по искусственному интеллекту. Если вы хотите, чтобы это сообщение приходило вам на почту каждую среду, нажмите ссылку и зарегистрируйтесь здесь.

На прошлой неделе OpenAI запустил расширенный голосовой режим с Vision, который передает видео в реальном времени в ChatGPT, позволяя чат-боту «видеть» за пределами уровня своего приложения. Предполагается, что, предоставив ChatGPT большую контекстуальную осведомленность, этот бот сможет реагировать более естественным и интуитивным образом.

Но когда я впервые попробовал это, оно обмануло меня.

«Этот диван выглядит удобным!» — сказал ChatGPT, когда я поднял телефон и попросил бота описать нашу гостиную. Он принял пуфик за диван.

«Моя ошибка!» ChatGPT сказал, когда я это исправил. «Ну, это все еще выглядит как удобное место».

Прошел почти год с тех пор, как OpenAI впервые продемонстрировала расширенный голосовой режим с помощью Vision, который компания представила как шаг к искусственному интеллекту, как показано в фильме Спайка Джонза «Она». В том виде, в каком его продавал OpenAI, расширенный голосовой режим с Vision предоставлял ChatGPT сверхспособности — позволяя боту решать математические задачи, читать эмоции и отвечать на нежные письма.

Достигнуто ли оно всего этого? Более или менее. Но расширенный голосовой режим с Vision не решил самую большую проблему ChatGPT: надежность. Во всяком случае, эта функция делает галлюцинации бота более очевидными.

В какой-то момент мне было любопытно узнать, может ли расширенный голосовой режим с Vision помочь ChatGPT предлагать советы по моде, я включил его и попросил ChatGPT оценить мой наряд. Он с радостью так и сделал. Но хотя бот высказывал мнение о моих джинсах и рубашке оливкового цвета, он постоянно пропускал коричневую куртку, которую я носил.

Я не единственный, кто столкнулся с промахами.

Когда президент OpenAI Грег Брокман ранее в этом месяце продемонстрировал расширенный голосовой режим с Vision в программе «60 минут», ChatGPT допустил ошибку в геометрической задаче. При вычислении площади треугольника он неправильно определил высоту треугольника.

Итак, мой вопрос: какой смысл в искусственном интеллекте, похожем на «Ее», если ему нельзя доверять?

С каждой осечкой ChatGPT я чувствовал, что становлюсь все менее и менее склонным лезть в карман, разблокировать телефон, запускать ChatGPT, открывать расширенный голосовой режим и включать Vision — громоздкая серия шагов в лучших обстоятельствах. Расширенный голосовой режим с его ярким и веселым поведением явно создан для того, чтобы вызывать доверие. Когда это неявное обещание не выполняется, это раздражает и разочаровывает.

Возможно, когда-нибудь OpenAI сможет решить проблему галлюцинаций раз и навсегда. А пока мы ограничены ботом, который смотрит на мир через перекрестные провода. И, честно говоря, я не уверен, кому это может понадобиться.

Новости

12 дней «шипмас» OpenAI продолжаются: OpenAI выпускает новые продукты каждый день до 20 декабря. Вот сводка всех анонсов, которые мы регулярно обновляем.

YouTube позволяет авторам отказаться от участия: YouTube предоставляет создателям больше выбора в отношении того, как третьи стороны могут использовать их контент для обучения своих моделей искусственного интеллекта. Авторы и правообладатели смогут пометить YouTube, если они разрешают конкретным компаниям обучать моделей в своих клипах.

Умные очки Meta получили обновления: Умные очки Ray-Ban Meta от Meta получили несколько новых обновлений на базе искусственного интеллекта, включая возможность постоянного общения с искусственным интеллектом Meta и перевода между языками.

Ответ DeepMind Соре: Google DeepMind, ведущая исследовательская лаборатория Google в области искусственного интеллекта, хочет победить OpenAI в игре по созданию видео. В понедельник DeepMind анонсировала Veo 2, ИИ нового поколения, генерирующий видео, который может создавать клипы продолжительностью более двух минут в разрешении до 4K (4096 x 2160 пикселей).

Информатор OpenAI найден мертвым: По данным Управления главного медицинского эксперта Сан-Франциско, бывший сотрудник OpenAI Сушир Баладжи был недавно найден мертвым в своей квартире в Сан-Франциско. В октябре 26-летний исследователь искусственного интеллекта выразил обеспокоенность по поводу нарушения OpenAI закона об авторском праве, когда давал интервью The New York Times.

Grammarly приобретает Coda: Компания Grammarly, наиболее известная своим стилем и инструментами проверки орфографии, приобрела продуктивный стартап Coda за нераскрытую сумму. В рамках сделки генеральный директор и соучредитель Coda Шишир Мехротра станет новым генеральным директором Grammarly.

Cohere работает с Palantir: TechCrunch эксклюзивно сообщил, что Cohere, корпоративный стартап в области искусственного интеллекта стоимостью 5,5 миллиардов долларов, заключил партнерство с фирмой по анализу данных Palantir. Palantir открыто заявляет о своем тесном — и порой противоречивом — сотрудничестве с оборонными и разведывательными службами США.

Научная статья недели

Anthropic приоткрыла занавески над Клио («кл.Од ядостопримечательности и оbservations»), системы, которую компания использует, чтобы понять, как клиенты используют различные модели искусственного интеллекта. Clio, который Anthropic сравнивает с аналитическими инструментами, такими как Google Trends, предоставляет «ценную информацию» для повышения безопасности искусственного интеллекта Anthropic, утверждает компания.

Anthropic обратилась к Clio для сбора анонимных данных об использовании, некоторые из которых компания обнародовала на прошлой неделе. Так для чего же клиенты используют ИИ Anthropic? Целый ряд задач, но первое место в списке занимает разработка веб-сайтов и мобильных приложений, создание контента и научные исследования. Как и ожидалось, варианты использования различаются в зависимости от языка; например, говорящие на японском языке чаще просят ИИ Anthropic проанализировать аниме, чем говорящие на испанском языке.

Модель недели

Стартап Pika, занимающийся искусственным интеллектом, выпустил модель поколения видео следующего поколения Pika 2, которая может создавать клип из персонажа, объекта и места, предоставленного пользователями. Через платформу Pika пользователи могут загружать несколько отсылок (например, изображения зала заседаний и офисных работников), и Pika 2 «интуитивно уловит» роль каждой отсылки, прежде чем объединить их в одну сцену.

Конечно, ни одна модель не идеальна. Посмотрите «аниме» ниже, созданное Pika 2, которое впечатляет стабильностью, но страдает от эстетической странности, присутствующей во всех кадрах, созданных с помощью генеративного ИИ.

pic.twitter.com/3jWCy4659o Как я уже сказал, аниме станет первым жанром, на 100% созданным искусственным интеллектом. Удивительно видеть, что уже возможно с Pika 2.0.

— Пухлый

(@kimmonismus) 16 декабря 2024 г.

Тем не менее, инструменты в области видео очень быстро совершенствуются — и в равной степени вызывают интерес и гнев креативщиков.

Захватите сумку

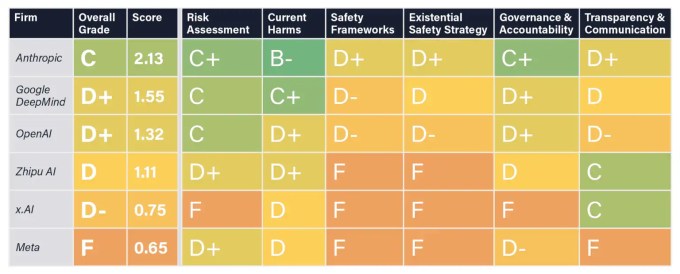

Институт будущего жизни (FLI), некоммерческая организация, соучредителем которой является космолог Массачусетского технологического института Макс Тегмарк, опубликовал «Индекс безопасности ИИ», предназначенный для оценки практики безопасности ведущих компаний, занимающихся ИИ, по пяти ключевым областям: текущий вред, системы безопасности, экзистенциальная безопасность. стратегия безопасности, управление и подотчетность, а также прозрачность и коммуникация.

Мета оказался худшим из всех, оцененных по Индексу, с общей оценкой F. (В Индексе используется числовая система оценок и балльная оценка на основе среднего балла.) Anthropic был лучшим, но не смог добиться результатов лучше, чем C, что позволяет предположить, что есть возможности для улучшения.